Un diagnostic d’audit « plausible » peut coûter très cher : le coût moyen mondial d’une violation de données a atteint 4,88 M$ selon IBM.

La bonne question n’est donc pas « peut-on automatiser l’audit ? », mais « peut-on fiabiliser le diagnostic, preuve à l’appui, et le rendre reproductible ? ». Dans un contexte DPO, la valeur de l’IA vient quand elle consolide vos données, aligne vos responsabilités, et accélère vos contrôles sans casser la traçabilité. Pour structurer cette démarche dans vos pratiques, appuyez-vous sur votre logiciel DPO.

L’essentiel en 30 secondes

Un diagnostic fiabilisé repose sur des preuves reliées, horodatées, et conservées selon un cadre clair.

La cartographie des flux de données et des transformations est le socle des contrôles automatisés.

Le scoring n’a de valeur que si les seuils, exceptions, et validations sont explicités et auditables.

La surveillance continue (dérives, faux positifs, performance) transforme l’audit en processus maîtrisé.

Avant d’automatiser les tests, vous devez rendre votre terrain d’audit « mesurable ».

Prérequis : un audit IA orienté fiabilité, pas orienté vitesse

Accès, inventaire, et cadre de preuves : votre base de vérité

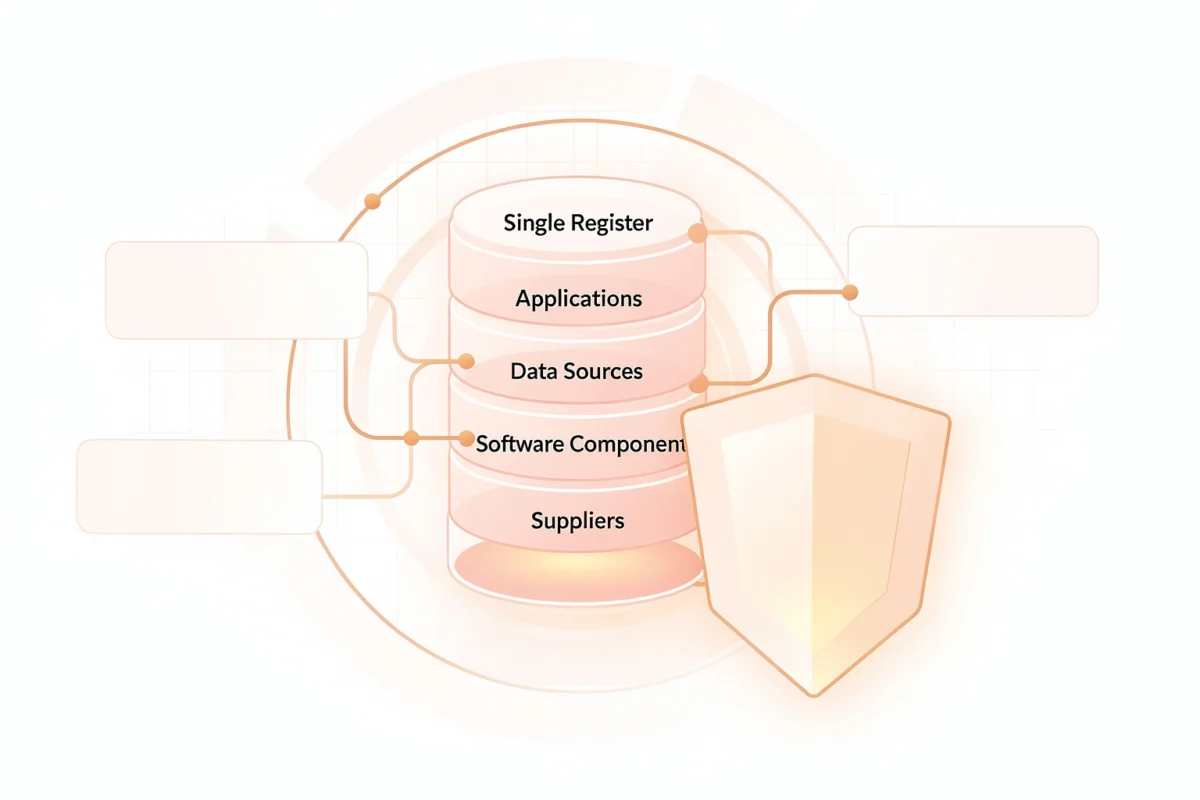

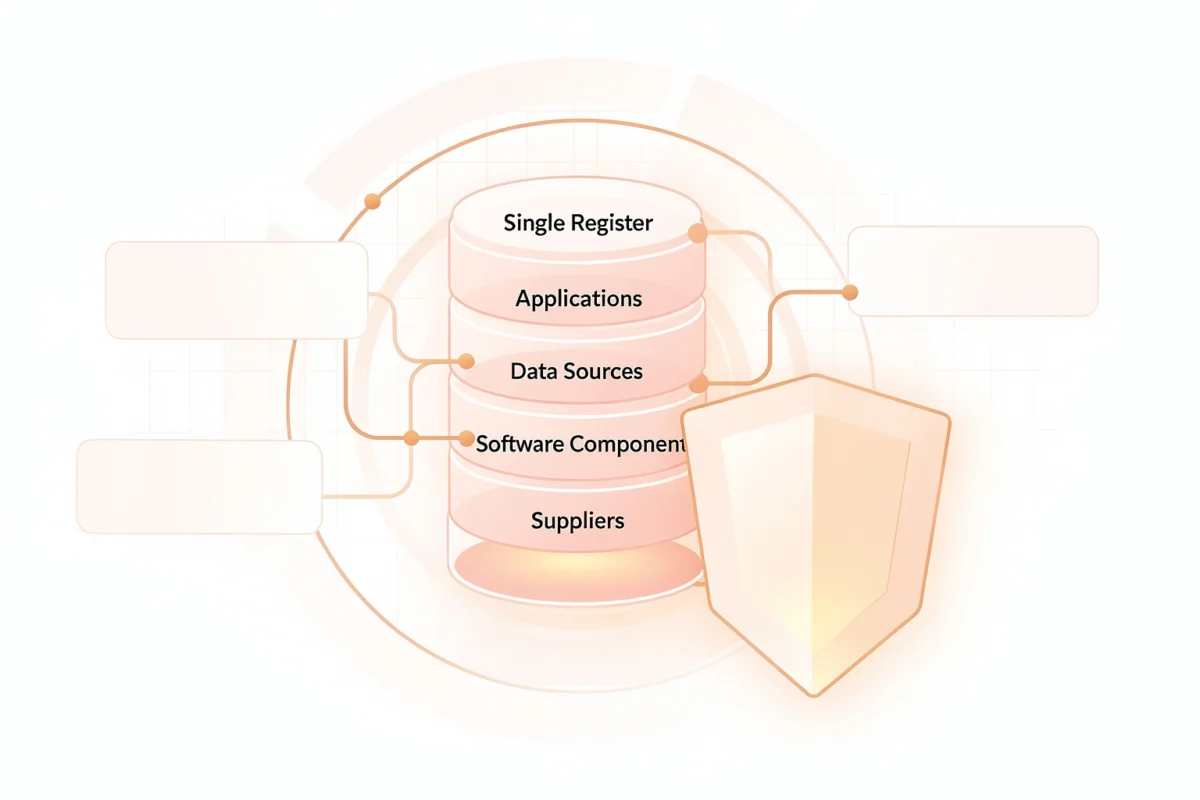

Un audit assisté par Intelligence Artificielle échoue rarement par manque d’algorithmes. Il échoue parce que les systèmes, les versions, et les flux ne sont pas inventoriés de manière exploitable. Commencez par lister, dans un registre unique, vos applications, vos sources de données, vos composants de sécurité, et vos fournisseurs. Pour chaque élément, consignez l’environnement, la version, le responsable, et le mode d’accès. Ce niveau de détail rend vos contrôles répétables et évite les « constats fantômes ». Voir aussi : impact de la gestion des données en France.

Ensuite, fixez un cadre de preuves. Une preuve n’est pas un document « rassurant ». C’est un artefact vérifiable : export, configuration, journal d’évènements, ticket, décision, ou rapport signé. La journalisation doit être conçue comme une pièce de conformité et de sécurité. La CNIL rappelle que l’objectif est de tracer les accès et les actions sur les systèmes multi-utilisateurs. CNIL Pour approfondir ce sujet, consultez notre article sur obligations clés en cybersécurité pour 2026.

Enfin, alignez la conservation. Pour les systèmes d’IA à haut risque, l’AI Act prévoit une conservation des journaux générés automatiquement d’au moins six mois, sauf règles spécifiques. AI Act (article 19) Ce thème est détaillé dans Conformité AI Act.

Checklist technique avant de démarrer

- Inventaire des systèmes, des modèles, des fournisseurs, des versions, et des environnements.

- Accès auditeur en lecture seule, traçable, avec séparation des rôles et des permissions.

- Catalogue des preuves attendu par contrôle (format, source, fréquence, responsable).

- Chaîne de traçabilité : horodatage, identité de l’auteur, intégrité, et politique de conservation.

- Politique de gestion des secrets : coffre-fort, rotation, et interdiction de copier des clés dans les tickets.

- Référentiel d’exigences : obligations externes et exigences internes, versionnées.

Un diagnostic fiabilisé commence par un inventaire actionnable, pas par un tableau de bord.

La preuve doit être définie avant le test, sinon vous « prouvez » après coup.

La journalisation est un pilier technique de la conformité et de la sécurité.

Une fois ces fondations posées, vous pouvez cartographier ce que l’IA doit expliquer et relier. Retrouvez également notre analyse complète : adaptation aux évolutions réglementaires.

Cartographier données et preuves : rendre l’audit vérifiable

Du flux de données à la preuve auditable

Cartographier, ce n’est pas dessiner une architecture idéale. C’est décrire les sources, les flux, les transformations, et les rétentions telles qu’elles existent. Pour chaque flux, documentez l’entrée, la transformation (jointure, anonymisation, enrichissement), la sortie, et le stockage. Ajoutez les points de contrôle : qui valide, qui exécute, qui peut modifier. Vous obtenez une vision « de bout en bout » qui relie processus, systèmes, et responsabilités. Ce thème est détaillé dans mise en conformité avec l’AI Act.

Évaluez ensuite la qualité des données à travers trois axes simples : complétude, cohérence, fraîcheur. La fiabilité d’un diagnostic dépend de la capacité à démontrer que le constat n’est pas basé sur des données périmées ou tronquées. C’est ici que l’IA est utile : elle repère des incohérences à grande échelle, mais vous devez lui imposer des règles de preuve. Utilisez une logique inspirée des fonctions « gouverner, cartographier, mesurer, piloter » promues par le référentiel de gestion des risques IA du NIST. NIST AI RMF Retrouvez également notre analyse complète : Double authentification – anticipation des obligations de sécurité.

Flux : données brutes (sources) → transformations (ETL, règles, masquage) → vues de contrôle (exports, captures, journaux) → preuves (tickets, rapports, décisions) → conservation (durée, intégrité, accès)

Contrôles d’accès : éviter le diagnostic « aveugle »

Un diagnostic fiabilisé exige de prouver qui a fait quoi, quand, et avec quel niveau de droits. Définissez des rôles (DPO, RSSI, administrateur, auditeur, métier) et associez-les à des permissions minimales. Vérifiez l’existence de journaux d’accès et d’administration, et assurez-vous qu’ils sont protégés contre l’altération. La recommandation de la CNIL sur la journalisation vous aide à cadrer la traçabilité des actions dans des systèmes multi-utilisateurs. CNIL Pour approfondir ce sujet, consultez notre article sur la mise en conformité à l’IA ou encore Intégration de l’IA dans le marketing digital.

Sans cartographie des flux, l’IA ne « fiabilise » rien : elle généralise.

Les preuves doivent remonter jusqu’aux données et aux journaux, pas seulement aux rapports.

Une cartographie utile doit être encadrée par un périmètre de conformité explicite, sinon l’IA optimise le mauvais objectif.

Délimiter le périmètre : transformer des obligations en exigences testables

Obligations applicables, cas d’usage, et risques : la grille qui évite les zones grises

Commencez par lister ce qui s’applique réellement : RGPD, exigences contractuelles, politiques internes, et contraintes sectorielles. Pour chaque obligation, traduisez-la en exigences testables. Exemple : « minimisation » devient « champs interdits », « conservation » devient « durée et purge », « sécurité » devient « chiffrement, gestion des secrets, et journalisation ». Cette transformation est votre stratégie : passer de textes à des contrôles. Ce thème est détaillé dans les bonnes pratiques du RGPD.

Ensuite, définissez les cas d’usage IA et les utilisateurs finaux. Un même système peut servir à la détection d’écarts, à la rédaction de rapports, ou à l’aide à la décision. Les impacts ne sont pas les mêmes. Formalisez les risques selon trois familles : juridique (droits, base légale), opérationnel (erreur, rupture de service), réputationnel (perte de confiance). Pour les systèmes d’IA à haut risque, l’AI Act renforce l’exigence de traçabilité via la conservation de journaux. AI Act (article 19)

Enfin, alignez la gouvernance. Définissez un RACI simple : qui est responsable, qui approuve, qui est consulté, qui est informé. Décrivez aussi les escalades : quand l’humain doit invalider l’IA, et qui arbitre une dérogation. Sans cela, vous aurez un diagnostic rapide, mais inapplicable.

- Périmètre : systèmes, processus, données, environnements, équipes.

- Exclusions : ce qui est hors audit, et pourquoi (justification).

- Hypothèses : accès disponibles, qualité des journaux, fenêtre temporelle.

- Critères d’arrêt : absence de preuve, conflit d’accès, risque critique.

Un périmètre clair transforme la conformité en contrôles concrets.

La gouvernance verrouille vos responsabilités et réduit les débats en fin d’audit.

Quand le périmètre est posé, vous pouvez industrialiser les contrôles, sans transformer l’audit en machine à faux positifs.

Automatiser tests et détections : accélérer sans dégrader la qualité

Contrôles documentaires, techniques et données : le trio qui fiabilise

Automatisez les contrôles documentaires. L’IA peut vérifier la présence, la version, la cohérence, et la fraîcheur de pièces attendues. Exemple : politique de conservation alignée avec les durées réelles observées, registre des traitements cohérent avec les flux, et rapports de sécurité datés. Ce niveau est souvent le plus rentable, car il réduit le temps passé à chercher.

Passez ensuite aux contrôles techniques : configurations, chiffrement, gestion des secrets, et exposition réseau. Ici, l’IA doit fonctionner comme un moteur de règles augmenté, pas comme un « juge ». Vos règles doivent être traçables, versionnées, et reliées à une exigence. Pour cadrer la gestion des risques, appuyez-vous sur une logique structurée de cartographie, mesure, et pilotage telle que décrite par le NIST AI RMF. NIST AI RMF

Enfin, contrôlez les données : dérives, anomalies, valeurs interdites, et incohérences. Le point de vigilance est le seuil. Un seuil trop bas crée des alertes inutiles. Un seuil trop haut rate des écarts réels. Votre objectif est un diagnostic fiabilisé, pas un bruit statistique.

| Famille de contrôles | Exemples testables | Preuves attendues |

|---|---|---|

| Documentaire | Présence, version, cohérence inter-documents | Registre, procédures, décisions, rapports |

| Technique | Chiffrement, secrets, durcissement, accès | Exports de config, journaux, captures |

| Données | Valeurs interdites, dérives, incohérences | Échantillons, métriques qualité, traces |

Flux : règles (versionnées) → scoring par contrôle → agrégation par exigence → alertes priorisées → action (corriger, justifier, escalader) → preuve liée

Automatisez ce qui est vérifiable, pas ce qui est « interprétable ».

Les seuils et les exceptions font partie du dispositif de conformité.

Vous voulez appliquer cette méthode dans vos audits DPO ? Demandez un cadrage opérationnel à MDP Data Protection.

Une fois les contrôles en place, la différence se joue sur la restitution : un diagnostic doit être traçable, et pas seulement lisible.

Produire un diagnostic fiabilisé : traçable, reproductible, défendable

Scoring, chaînes d’approbation, et gestion des exceptions

Un scoring utile repose sur des critères stables. Définissez des pondérations par exigence, puis des seuils décisionnels. Exemple : « conforme », « conforme sous réserve », « non conforme ». Chaque score doit renvoyer vers des preuves et vers la règle appliquée. Sans lien preuve-règle, vous ne fiabilisez pas : vous calculez.

La traçabilité se construit avec des horodatages, une identité d’auteur, et une chaîne d’approbation. L’objectif est de pouvoir rejouer l’audit : mêmes entrées, mêmes sorties, mêmes écarts. Cette reproductibilité protège votre direction face à un contrôle externe, mais aussi face à un litige. Elle réduit aussi les débats internes, car le diagnostic devient vérifiable.

La gestion des exceptions est votre soupape de conformité. Toute dérogation doit inclure une justification, un responsable, une durée, et une date de revue. C’est cohérent avec l’esprit de la journalisation : tracer les actions et les décisions, pas seulement les accès. CNIL

- Exigence : texte interne/externe, version, périmètre.

- Contrôle : règle, seuil, date d’exécution, environnement.

- Résultat : score, catégorie, impact, risque associé.

- Preuves : liens internes de preuve, hash ou identifiant, horodatage.

- Décision : approuvé, refusé, dérogation, escalade, responsable.

Le scoring n’est crédible que s’il renvoie vers des preuves et des règles versionnées.

Les exceptions doivent être gérées comme un processus, pas comme un commentaire.

Un diagnostic peut être traçable et pourtant injuste ou fragile, si les biais ne sont pas testés et documentés.

Réduire les biais et renforcer l’explicabilité : éviter la surconfiance

Biais, tests d’équité, et explicabilité utile en audit

Cartographiez les biais selon quatre sources : données, modèle, processus, et humain. Les biais de données viennent des manques, des surreprésentations, et des libellés ambigus. Les biais de modèle viennent des objectifs d’optimisation et des approximations. Les biais de processus viennent d’un mauvais périmètre ou d’une gouvernance floue. Les biais humains viennent de la pression, des habitudes, et de l’effet d’autorité de l’IA.

Pour fiabiliser, testez l’équité par segments pertinents : typologie d’établissements, zones, métiers, ou niveaux de maturité sécurité. Choisissez des métriques simples : taux de faux positifs par segment, taux d’écarts réels confirmés, et stabilité du scoring. Encadrez ces tests dans une approche de gestion des risques structurée, telle que promue par le NIST AI RMF. NIST AI RMF

L’explicabilité utile en audit n’est pas une « justification narrative ». Elle doit pointer des facteurs, des règles, et des limites. Point de vigilance : certaines explications peuvent être convaincantes mais trompeuses. Imposer des preuves et des règles réduit ce risque, car l’explication devient vérifiable.

| Type de biais | Test recommandé | Remédiation concrète |

|---|---|---|

| Données | Complétude par segment, détection d’anomalies | Règles de qualité, enrichissement, correction de référentiels |

| Modèle | Stabilité des résultats, dérive de performance | Recalibrage, contraintes, garde-fous de décision |

| Processus | Revue des exceptions, contrôle des seuils | RACI, validations, politiques de dérogation |

| Humain | Contre-audit échantillonné, revue croisée | Formation, checklists, règles d’invalidation |

L’explicabilité en conformité doit être vérifiable, pas seulement « compréhensible ».

Mesurez les faux positifs : c’est un indicateur direct de fiabilité du diagnostic.

Après l’explicabilité, le défi est la durée : sans surveillance, un diagnostic fiable aujourd’hui devient fragile demain.

Surveillance et amélioration continue : passer d’un audit ponctuel à un pilotage

Observabilité, boucle corrective, et indicateurs de fiabilité

Surveillez trois dérives : dérive des données (qualité, fraîcheur), dérive de performance (stabilité des scores), et dérive des comportements (contournements, usages non prévus). La surveillance doit produire des signaux actionnables : alertes priorisées, et non un flux continu d’évènements. La journalisation, encadrée par les recommandations de la CNIL, donne une base solide pour tracer les actions et analyser un incident. CNIL

Structurez ensuite une boucle corrective : priorisation, plan, re-tests, validation, et mise à jour des règles. Vos indicateurs de fiabilité doivent relier conformité et performance : taux d’écarts réels confirmés, couverture des contrôles, délai de détection, et latence de correction. C’est aussi un langage commun pour la direction : vous démontrez l’efficacité des actions, pas seulement la quantité de rapports.

Préparation aux enjeux de deux mille vingt-six : agents IA plus autonomes, génération augmentée par recherche documentaire (RAG), et contrôles nouveaux sur la traçabilité des décisions. Plus l’autonomie progresse, plus vos garde-fous doivent être testables et auditables.

Flux : évènements (journaux, métriques) → corrélation (règles) → signal (écart probable) → ticket (action) → correction → re-test → preuve de clôture

La surveillance transforme la conformité en processus continu, pas en « photo » annuelle.

Un bon indicateur relie un écart, une action, et une preuve de clôture.

Vous voulez industrialiser la surveillance et les rapports pour vos obligations DPO ? Formalisez un référentiel de contrôles et une boucle corrective outillée.

La surveillance apporte des signaux, mais vous devez prouver que le dispositif produit des résultats fiables.

Validation et résultats : prouver que l’IA fiabilise réellement le diagnostic

Critères d’acceptation, revue croisée, et livrables finaux

Vérifiez que « ça marche » avec des critères d’acceptation simples : couverture des exigences, précision des écarts, traçabilité des preuves, et reproductibilité. La revue croisée est votre filet de sécurité : auditeur, sécurité, données, métier. Elle réduit les angles morts, et clarifie les responsabilités. Une approche structurée de gestion des risques, comme celle du NIST AI RMF, aide à cadrer cette validation sans débat infini sur les opinions. NIST AI RMF

Vos livrables doivent être exploitables : rapport de diagnostic fiabilisé, pack de preuves (indexé), et plan de remédiation priorisé. Un rapport sans actions est un document, pas un dispositif. Un plan sans preuves est une promesse, pas une conformité.

Enfin, mesurez l’impact. IBM montre que l’usage étendu de l’IA et de l’automatisation en prévention est associé à une réduction moyenne de 2,2 M$ des coûts de violation, par rapport à l’absence de ces technologies. IBM

| Problème fréquent | Cause racine | Solution opérationnelle |

|---|---|---|

| Constats non défendables | Preuves non reliées aux règles | Index de preuves, règles versionnées, modèle de constat standard |

| Trop d’alertes | Seuils mal calibrés, données bruitées | Revue des seuils, métriques de faux positifs, tests par segment |

| Audit non reproductible | Inventaire incomplet, versions non tracées | Inventaire systèmes et modèles, gel des règles, horodatage |

| Conflits entre équipes | Gouvernance floue, responsabilités implicites | RACI, escalades, critères d’invalidation et de dérogation |

La validation doit tester la précision, la traçabilité, et la reproductibilité.

Un diagnostic fiabilisé se mesure aussi à sa capacité à déclencher des actions correctives.

FAQ : diagnostic fiable et audit de conformité

Quelle différence entre fiabilité et conformité ?

La conformité décrit l’alignement à des obligations et exigences. La fiabilité décrit la solidité du diagnostic : preuves, traçabilité, et reproductibilité. Vous pouvez être « conforme sur le papier » avec un diagnostic fragile. À l’inverse, un diagnostic fiable met en évidence les écarts et déclenche une gestion structurée des risques.

Comment éviter les hallucinations dans les constats produits par l’IA ?

Vous les évitez en interdisant les constats sans preuve. Chaque affirmation doit renvoyer à une pièce auditable : export, journal, ticket, ou configuration. Ajoutez des règles versionnées, des seuils explicites, et une revue croisée. La traçabilité et la journalisation, telles que cadrées par la CNIL, réduisent fortement les dérives. CNIL

Quels indicateurs prouvent une évaluation robuste ?

Priorisez des indicateurs orientés décision : taux d’écarts réels confirmés, taux de faux positifs, couverture des exigences, et délai moyen entre détection et correction. Ajoutez un indicateur de reproductibilité : relancer les mêmes contrôles doit produire les mêmes résultats, à règles identiques. C’est le cœur d’un diagnostic fiabilisé.

Quand l’humain doit-il invalider l’IA ?

L’humain invalide dès qu’une preuve manque, qu’un périmètre est ambigu, ou qu’une exception est demandée. Il invalide aussi quand un résultat a un impact juridique ou opérationnel élevé. La bonne pratique est d’industrialiser ces cas via une gouvernance : RACI, escalades, et critères d’arrêt, plutôt que via des arbitrages informels.

Combien de temps faut-il pour obtenir un diagnostic fiabilisé exploitable ?

Le délai dépend surtout de la maturité des systèmes, des journaux, et des preuves. Si l’inventaire et la traçabilité sont prêts, l’automatisation des contrôles documentaires et techniques peut produire un premier diagnostic rapidement. Sinon, la phase de cartographie et de mise à niveau des journaux devient le chemin critique, notamment pour respecter des exigences de conservation. AI Act (article 19)

Comment auditer un fournisseur ou un SaaS d’IA sans perdre la maîtrise ?

Exigez un périmètre clair, des preuves exportables, et une traçabilité des accès et décisions. Demandez la description des modèles, versions, et changements. Vérifiez la journalisation, les mécanismes de contrôle, et la capacité à rejouer un diagnostic. Une approche de gestion des risques structurée aide à cadrer ces demandes de manière proportionnée. NIST AI RMF

Un audit assisté par IA n’est crédible que s’il produit un diagnostic fiabilisé, relié à des preuves, et défendable devant un contrôle. En pratique, la différence se joue sur la cartographie des données, la gouvernance, et la qualité des journaux, bien plus que sur la sophistication des modèles. Si vous structurez vos contrôles, vos seuils, et votre boucle de surveillance, vous transformez l’audit en pilotage continu. Le résultat attendu est simple : moins de débats, plus d’actions, et des rapports qui tiennent face à la direction.